本文來源:京東云開發者社區

隨著5G、人工智能、物聯網、智慧城市的蓬勃發展以及大數據、云計算技術的深入發展和應用,作為數據計算、存儲或連接交換的基礎支撐與驅動技術進步的基石,數據中心是中國推進新一代信息技術產業發展的關鍵資源,數據中心的發展將持續強勁增長。隨著5G、人工智能、物聯網、智慧城市的蓬勃發展以及大數據、云計算技術的深入發展和應用,作為數據計算、存儲或連接交換的基礎支撐與驅動技術進步的基石,數據中心是中國推進新一代信息技術產業發展的關鍵資源,數據中心的發展將持續強勁增長。

CPU頻率更高!

計算速度更快!

圖像處理更強!

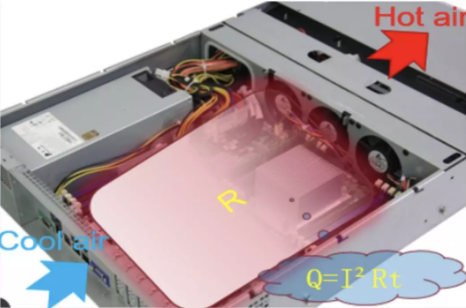

服務器能力的遞增,隨之而來的就是整體功耗的上漲;而機房布局面積限定與機架尺寸限定使得服務器的體積不能有太大的變化,要在有限的空間里裝進無限可能,服務器只能在“功耗胖子”的路上越走越遠······

功耗的增加必然會導致服務器的散熱需求的增加,那么這個越來越胖的家伙怎么才能進行有效地散熱呢?

相信大家都會有這樣的生活經驗,在炎炎夏日中我們如何才能舒適愜意?

最初的辦法就是找個樹蔭,曬不到就涼快了!

如果還是熱?那就扇扇子!

再不行?那就開空調!

依然不行?那就直接去沖個涼吧!

電子設備的散熱設計也是相似的歷程,最初的自然散熱設備只要找個溫度不高的使用環境就能很好的工作了,散熱設計?ME隨便擺一下就OK了!

自然扇熱設備

當慢慢自然散熱搞不定的時候,風冷散熱模式上線,系統里放幾顆風扇、整體風道劃分,散熱問題就能解決,輕松加愉快!

風冷散熱設備

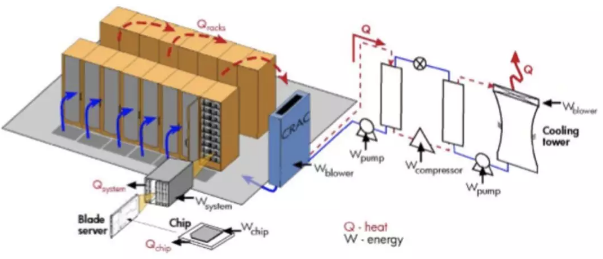

再后來電子設備尤其是服務器的需求量增大,集群部署能更好的運營管理,數據中心機房要維持良好的設備運行環境,機房空調就必不可少,無論集中送風還是冷水列間,機房環境溫度低了,服務器也就安生了!

傳統數據中心制冷流程圖

當前電子設備的功耗密度已經是最初的幾倍甚至十幾倍,設備不斷更新迭代,但機房沒法跟上更新的節奏,部署密度受限、機房供風不足、整體PUE過高等這些問題亟待解決;對服務器端,功耗明顯上升的都是個別部件,整個系統熱島現象明顯,受限于結構空間,只能不斷的加大系統風量,就要求風扇的轉速越來越高,伴隨的就是震動強、噪聲高、功耗大;面對這些問題,風冷散熱模式捉襟見肘,用冷水沖個涼吧!

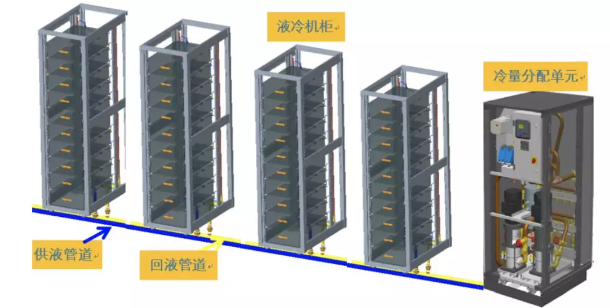

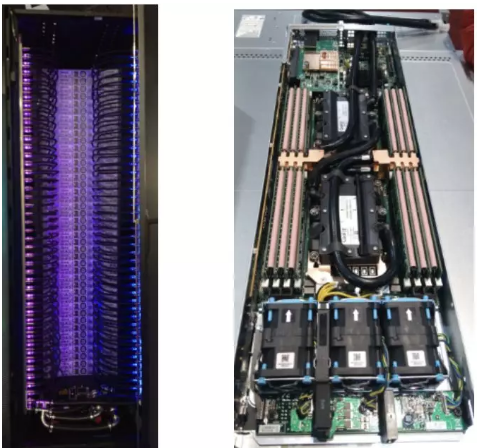

數據中心液冷機房

工質在散熱設計中扮演搬運工的角色,搬運工人數可理解為密度,單人每次負重量理解為比熱容C,單位時間內搬運的次數就是換熱系數h;空氣的比熱容約為1.0KJ/(KgK)、換熱系數20~100 W/(m2K)、密度約為1.3g/L,而水的比熱容約為4.0KJ/(Kgk)、換熱系數200~1000 W/(m2K)、密度約為1Kg/L;簡單換算工作效率可以得到,風冷相當于一個人搬、一次搬運一個箱子、單位時間搬運20次,而水冷就相當于770人搬、每人一次搬運4個箱子,每人單位時間搬運200次,理論上是風冷的3萬倍!實際運行中因各類限制,不會達到這么大的差距,但液冷的散熱效率也是風冷的幾千倍。

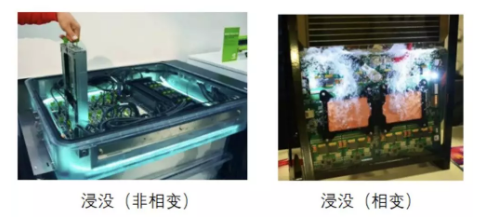

液冷的方式有多種,主要可以歸納為浸沒式、噴淋式、冷板式三個大類;

浸沒式:將整個服務器直接浸泡在工作介質中,根據工質工作狀態可細分為非相變和相變兩類;

噴淋式:工質通過服務器上蓋板,直接滴漏或噴射在服務器的熱源上,再通過服務器底殼收集運出,通常工質不發生相變;

噴淋式液冷服務器

冷板式:工質通常選用純水,利用管路輸送進服務器,再通過冷板與系統熱源發生換熱后導出服務器。

冷板式液冷服務器

綜合考慮機房運維、系統性能、上線風險等方面,目前容易接受且應用最多的是冷板式液冷模式;根據循環架構的不同,又可分為開式循環系統和閉式循環系統。

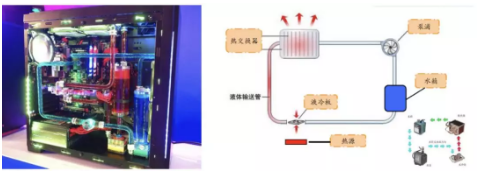

閉式系統是自循環的小系統,最常見的應用是PC主機箱液冷,透明機箱加帶色的工質,系統一運轉,非常炫酷:

閉式循環系統系統&原理

與閉式循環系統相比,開式系統對機房節可能更有幫助。它能夠將熱量轉移至室外進行散熱,減少機房的空調用量,降低整體PUE。

系統通常劃分成一次側和二次側兩部分,一次側為機房供水,包括室外的干冷器和冷水機組;二次側為機房內布局部分,包括供液環路和服務器內部流道;兩個部分通過CDU(Coolant Distribution Unit冷量分配單元)中的板式換熱器發生間壁式換熱,工質不做混合。

開式循環系統

冷板式液冷服務器主要由快速接頭、管路和冷板組成:

快速接頭可以實現帶壓插拔維護服務器,水路的自動斷開和導通;

管路負責水路的運輸工作,在服務器內進行流道設計;

液冷板的作用是提供冷水與熱源之間換熱的場所,內部有各類流道設計應對不同使用場景。

根據DCFF發布的《中國數據中心能源使用報告2018》,截止2018年底,中國大小數據中心總量在40萬個以上,在線使用服務器數量超過1200萬臺,年增長率在13.4%~17.7%之間,所有服務器及網絡設備耗電量約324.4億度電,占全社會總用電量1%,隨著數據中心的數量及服務器保有量增加,該比例會持續增大,達到或接近美國數據中心社會總用電量占比的1.5%~2%水平。

初步評估,液冷機房的PUE可以做到1.1左右,即324.4億度電需要的散熱配套設備功耗為32.44億度電,而當前較好的風冷機房PUE平均可以做到1.4左右,即散熱配套設備功耗為129.76億度電;液冷一年可以節省97億度電!相當于千萬級人口大城市的年均居民用電總量。

由于其回液溫度明顯高于傳統空調系統回液,廢熱品味顯著提高,可以大幅度提升熱回收應用價值,在未來規劃利用新型數據中心余熱回收技術,為需求場所提供綠色清潔的熱源,從而達到能源的高效與綠色化應用。

-END-

培訓通知:

標簽: 點擊: 評論: