一,液冷應用的完美案例

隨著技術和產品的革新,近幾年來一些頂尖玩家甚至開始用礦物油或者液態氮來推動硬件的極限效能。而這些液冷技術已經也開始被廠商用作服務器和數據中心散熱中去。我們現在可以看到越來越多新奇技術的應用,像是老式的浸沒服務器冷卻罩,液體刀片服務器,礦物油冷卻服務器等等。

我們認為采用這些新奇技術所節省下面的成本是相當可觀的,企業不必企業可以不必維護龐大的冷媒壓縮機、管線、散熱水槽與風扇等設備,在目前日益重視的節能與成本議題上,服務器油冷設備的確顯現了不錯的競爭力。但在一線的機房人員會如何看待些裝置我們還不得而知,只是這些炫酷的技術就已經把我們帶進花花水世界,讓我們應接不暇了吧。

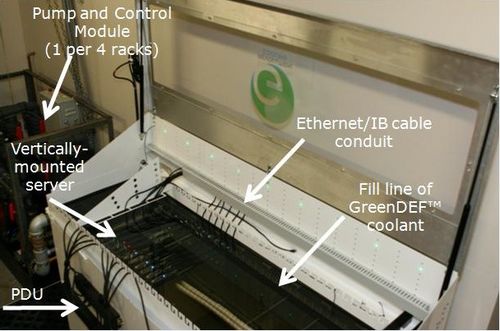

首先我們要來看一個液冷應用的非常好的案例。在 Intel 與油冷設備廠商 Green Revolution Cooling 歷經一年的合作測試下,服務器油冷散熱無論在冷卻與節能效率上皆能輕易擊敗傳統空冷形式,而且 Green Revolution Cooling 認為這項裝置兼顧了安全性與硬件可靠性,并且仍有進步的空間。

?工作人員將服務器浸入礦物油

在這項為期長達一年的試驗中,英特爾利用礦物油對服務器進行冷卻,比較與傳統的空氣冷卻技術的耗能。實驗數據表明礦物油冷卻技術比傳統的空氣冷卻的耗能要低90%至95%。

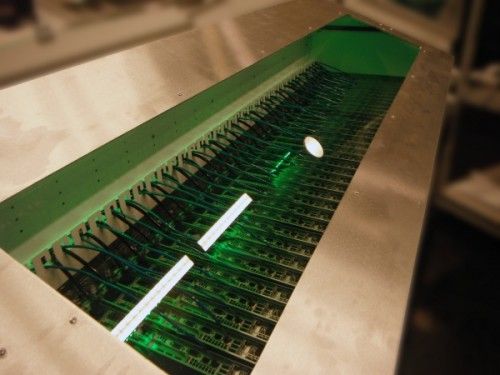

?礦物油冷卻服務器

Green Revolution Cooling (GRC),是一家位于德克薩斯州的成立兩年的公司,主要是提供液體冷卻技術解決方案。在2009年超級計算機大會上,Green Revolution Cooling 推出了礦物油制冷技術,并且在2010年的超算大會上被選為2009年年度突破性技術。他們利用比熱容是空氣的1200倍的一種礦物油來對服務器進行冷卻,使得冷卻耗能最高節省了95%。

隨著技術和產品的革新,近幾年來一些頂尖玩家甚至開始用礦物油或者液態氮來推動硬件的極限效能。而這些液冷技術已經也開始被廠商用作服務器和數據中心散熱中去。我們現在可以看到越來越多新奇技術的應用,像是老式的浸沒服務器冷卻罩,液體刀片服務器,礦物油冷卻服務器等等。

我們認為采用這些新奇技術所節省下面的成本是相當可觀的,企業不必企業可以不必維護龐大的冷媒壓縮機、管線、散熱水槽與風扇等設備,在目前日益重視的節能與成本議題上,服務器油冷設備的確顯現了不錯的競爭力。但在一線的機房人員會如何看待些裝置我們還不得而知,只是這些炫酷的技術就已經把我們帶進花花水世界,讓我們應接不暇了吧。

首先我們要來看一個液冷應用的非常好的案例。在 Intel 與油冷設備廠商 Green Revolution Cooling 歷經一年的合作測試下,服務器油冷散熱無論在冷卻與節能效率上皆能輕易擊敗傳統空冷形式,而且 Green Revolution Cooling 認為這項裝置兼顧了安全性與硬件可靠性,并且仍有進步的空間。

?工作人員將服務器浸入礦物油

在這項為期長達一年的試驗中,英特爾利用礦物油對服務器進行冷卻,比較與傳統的空氣冷卻技術的耗能。實驗數據表明礦物油冷卻技術比傳統的空氣冷卻的耗能要低90%至95%。

?礦物油冷卻服務器

Green Revolution Cooling (GRC),是一家位于德克薩斯州的成立兩年的公司,主要是提供液體冷卻技術解決方案。在2009年超級計算機大會上,Green Revolution Cooling 推出了礦物油制冷技術,并且在2010年的超算大會上被選為2009年年度突破性技術。他們利用比熱容是空氣的1200倍的一種礦物油來對服務器進行冷卻,使得冷卻耗能最高節省了95%。

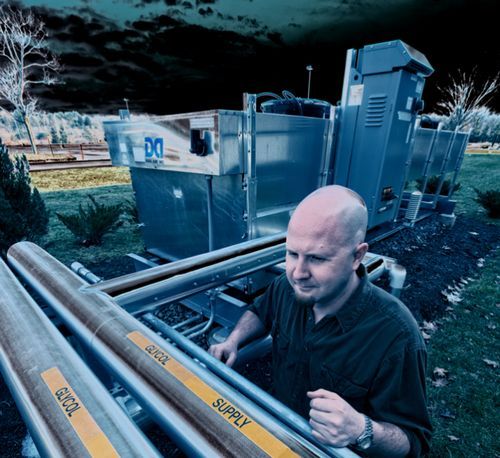

二,水冷技術發展及典型

水冷技術的發展歷史及典型代表

1964-1990期間,大型主機采用的是水冷技術。然后,出現了互補金屬氧化物半導體晶體管制造技術。該發明大大降低了芯片自身運行時產生的熱量并且能把熱量排給空氣制冷設備。在很多年里,水冷技術也一直被高性能個人計算機所使用。由于筆記本電腦內部空間狹小,空氣制冷卻起不到應有的作用,所以許多筆記本系統都是采用水冷技術。

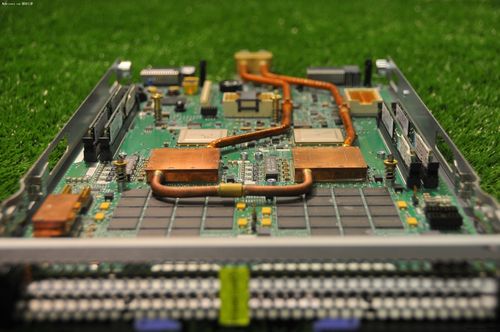

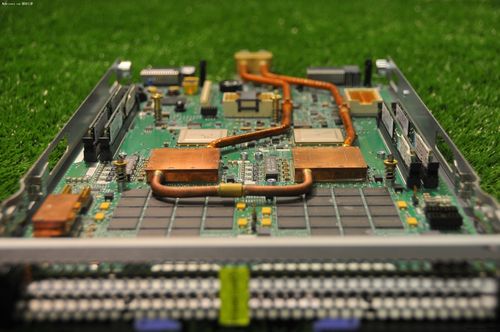

水冷服務器內部

盡管水冷技術更實用,但由于低熱負荷時空氣制冷卻成本也較低,所以IT產業轉向使用空氣制冷卻。但隨著時間推移,芯片越發密集,工作頻率一路飆升,這兩個因素都導致了電力需求和處理器熱排量呈指數倍上升。

在計算機發展過程中,我們經常把系統性能限制認定為“運算約束”或是“I/O約束”。而今天的處理器則是“熱約束”。在傳導熱方面,水比空氣有效得多。用于冷卻時,水大約比空氣有效3500倍。

水冷服務器

有了水冷處理器,芯片和服務器廠商無形中被賦予了開發超大運算能力的機會。試想一下,使用一個更有效的冷卻技術可能帶來的成本節約和數據中心的成長可能性。

可以說是IBM翻開了水冷技術的發展歷程,因為IBM最先使用水冷技術的時間可以追溯到1966年。當時,IBM推出了System/360型91大型計算機。這款計算機是當時運算速度最快、性能最強的機器,主要被設計用來處理科學應用的高速數據處理(比如太空探索、亞原子物理學、全球氣候預測等等)。因此,為了確保 大型機在長期的高速運算中不會發生過熱而宕機的事件,IBM就研發了這種專門的水冷系統。

IBM 3081

IBM 3081型機是一款結構非常復雜的大型機(誕生于1980年11月12日)。在這款機器上擁有兩個最具特色的高能效設計。其中一個是從大型機之前的68KW功耗降低到23KW,另外則內置有水冷技術,在傳統的風冷設計的基礎上還新增了散熱片。

2006年IBM研究人員展示了最新的旨在提高計算機芯片散熱效率的新技術:直射式散熱。這是一種水冷技術的新突破,在一個密閉的系統中將水直接噴射至芯片背板,并隨后將吸附芯片熱量的水分吸干。這套系統采用了多達5萬個噴嘴和1個復雜的樹狀回路結構系統。

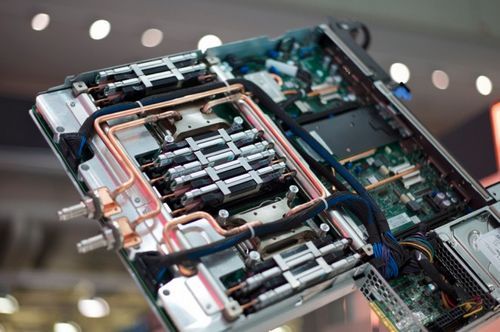

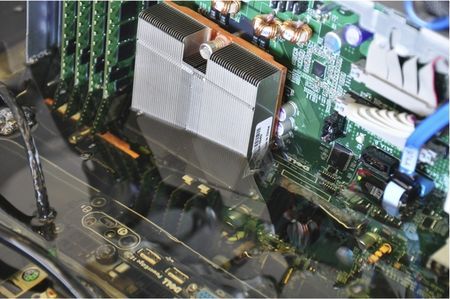

IBM Power575

2008年4月,IBM展示了其首個采用水冷技術的超級計算機Power 575。這款Unix機器包括 有14個內置水冷管道的服務器。這些水冷管道通過機架直接接入到服務器上,并配合處理 器散熱器上的水冷銅座共同發揮作用。

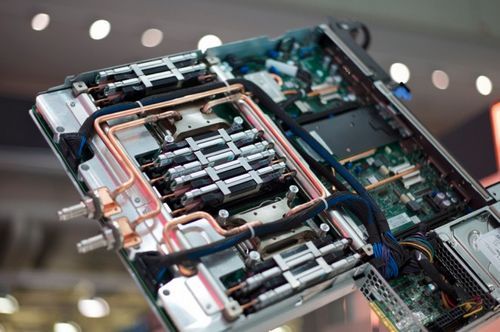

Aquasar服務器內部

2010年7月,IBM展示了首款采用“熱水”的超級計算機Aquasar。該超級計算機是IBM為蘇黎士瑞士聯邦技術研究院而設計的計算機。水冷技術的發展也由此而翻開了新的篇章。

打開該系統的刀片式服務器機箱就能發現,其主板上的每顆CPU都由液冷頭覆蓋,其間則使用細導管連接,導出機箱后再連接到更大型的回路系統中。水在處理器附近被加熱后,就會通過細管流入機房所在建筑的暖氣管道中,參與地暖系統供熱,熱量耗盡后冷卻再流回服務器形成循環。由于該系統被安置在普通風冷機柜旁邊,除了液冷處理器散熱外,不需要其他任何散熱措施。

據稱,這款超級計算機相比同樣配置的風冷超級計算機可減少40%的能耗。而且余熱還可以被用來對整個大學建筑物進行取暖,Aquasar的碳排放也因此減少了85%。

水冷技術的發展歷史及典型代表

1964-1990期間,大型主機采用的是水冷技術。然后,出現了互補金屬氧化物半導體晶體管制造技術。該發明大大降低了芯片自身運行時產生的熱量并且能把熱量排給空氣制冷設備。在很多年里,水冷技術也一直被高性能個人計算機所使用。由于筆記本電腦內部空間狹小,空氣制冷卻起不到應有的作用,所以許多筆記本系統都是采用水冷技術。

水冷服務器內部

盡管水冷技術更實用,但由于低熱負荷時空氣制冷卻成本也較低,所以IT產業轉向使用空氣制冷卻。但隨著時間推移,芯片越發密集,工作頻率一路飆升,這兩個因素都導致了電力需求和處理器熱排量呈指數倍上升。

在計算機發展過程中,我們經常把系統性能限制認定為“運算約束”或是“I/O約束”。而今天的處理器則是“熱約束”。在傳導熱方面,水比空氣有效得多。用于冷卻時,水大約比空氣有效3500倍。

水冷服務器

有了水冷處理器,芯片和服務器廠商無形中被賦予了開發超大運算能力的機會。試想一下,使用一個更有效的冷卻技術可能帶來的成本節約和數據中心的成長可能性。

可以說是IBM翻開了水冷技術的發展歷程,因為IBM最先使用水冷技術的時間可以追溯到1966年。當時,IBM推出了System/360型91大型計算機。這款計算機是當時運算速度最快、性能最強的機器,主要被設計用來處理科學應用的高速數據處理(比如太空探索、亞原子物理學、全球氣候預測等等)。因此,為了確保 大型機在長期的高速運算中不會發生過熱而宕機的事件,IBM就研發了這種專門的水冷系統。

IBM 3081

IBM 3081型機是一款結構非常復雜的大型機(誕生于1980年11月12日)。在這款機器上擁有兩個最具特色的高能效設計。其中一個是從大型機之前的68KW功耗降低到23KW,另外則內置有水冷技術,在傳統的風冷設計的基礎上還新增了散熱片。

2006年IBM研究人員展示了最新的旨在提高計算機芯片散熱效率的新技術:直射式散熱。這是一種水冷技術的新突破,在一個密閉的系統中將水直接噴射至芯片背板,并隨后將吸附芯片熱量的水分吸干。這套系統采用了多達5萬個噴嘴和1個復雜的樹狀回路結構系統。

IBM Power575

2008年4月,IBM展示了其首個采用水冷技術的超級計算機Power 575。這款Unix機器包括 有14個內置水冷管道的服務器。這些水冷管道通過機架直接接入到服務器上,并配合處理 器散熱器上的水冷銅座共同發揮作用。

Aquasar服務器內部

2010年7月,IBM展示了首款采用“熱水”的超級計算機Aquasar。該超級計算機是IBM為蘇黎士瑞士聯邦技術研究院而設計的計算機。水冷技術的發展也由此而翻開了新的篇章。

打開該系統的刀片式服務器機箱就能發現,其主板上的每顆CPU都由液冷頭覆蓋,其間則使用細導管連接,導出機箱后再連接到更大型的回路系統中。水在處理器附近被加熱后,就會通過細管流入機房所在建筑的暖氣管道中,參與地暖系統供熱,熱量耗盡后冷卻再流回服務器形成循環。由于該系統被安置在普通風冷機柜旁邊,除了液冷處理器散熱外,不需要其他任何散熱措施。

據稱,這款超級計算機相比同樣配置的風冷超級計算機可減少40%的能耗。而且余熱還可以被用來對整個大學建筑物進行取暖,Aquasar的碳排放也因此減少了85%。

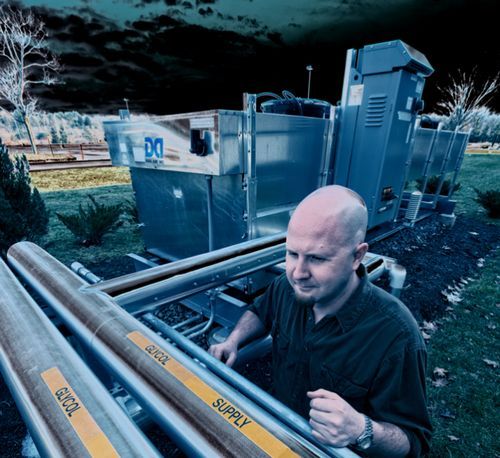

三,液體冷卻實驗操作過程

液體冷卻實驗操作過程

英特爾和Green Revolution Cooling將服務器浸入到250加侖的礦物油中,礦物油的溫度通過一個熱交換機保持低溫。英特爾的架構工程師相信,通過控制服務器的熱度,及時的熱量轉移能夠提高處理器的處理速度。

液體冷卻實驗操作過程

英特爾和Green Revolution Cooling將服務器浸入到250加侖的礦物油中,礦物油的溫度通過一個熱交換機保持低溫。英特爾的架構工程師相信,通過控制服務器的熱度,及時的熱量轉移能夠提高處理器的處理速度。

礦物油冷卻系統

在礦物油冷卻系統中,一個熱交換機可以控制4個機架的礦物油溫度。在每個特制的機架中,有電源、網線接口等等。

礦物油冷卻系統結構

不同于普通機架的一層一層的結構,在礦物油冷卻系統的機架中,服務器是類似刀片的插入到礦物油中。

礦物油冷卻服務器

一個傳統的數據中心需要設計服務器單元,需要空調單元并且一些其它建筑架構設計,但是采用礦物油冷卻技術,架構的設計要求比較少。從另外一個角度來說,這又為企業節省了費用。

礦物油冷卻服務器

為期一年的測試結束后,英特爾表示在考察數據中心能源效率的重要指標PUE上,礦物油冷卻系統能夠達到1.02至1.03,相比于傳統空氣冷卻的數據中心的1.8來比,有著巨大的節能提升。

四,液冷優勢所在

液體冷卻優勢所在

液體冷卻能夠很容易的就將服務器運行產生的熱量覆蓋并轉移到其他地方。另外,由于沒有風扇和空氣,服務器的設備出錯的概率也降低了,風扇癱瘓容易導致系統過熱而出現問題,而空氣中的灰塵也有可能引發其他問題。

液體冷卻優勢所在

液體冷卻能夠很容易的就將服務器運行產生的熱量覆蓋并轉移到其他地方。另外,由于沒有風扇和空氣,服務器的設備出錯的概率也降低了,風扇癱瘓容易導致系統過熱而出現問題,而空氣中的灰塵也有可能引發其他問題。

傳統服務器的風扇

在傳統服務器中,往往有許多風扇,為發熱比較高的處理器進行冷卻,而一旦風扇出現問題,服務器就會因CPU過熱而出現故障問題。此外空氣中也會有許多灰塵,采用空氣制冷不可避免的是灰塵在服務器內部堆積的情況,而灰塵累計過多也會影響系統的散熱。

主板下面的塑料硬膜

傳統的服務器為了防止灰塵,許多都會在主板下面加入了塑料硬膜阻止灰塵進入主板。此外又不能將服務器內部元件封閉起來,因為那樣就會阻擋通風,導致元件過熱。就在硬膜上設置了幾個小孔。

礦物油中的服務器

采用礦物油冷卻技術,風扇和灰塵都不會影響服務器的運行。而與水不同的是,礦物油是非極性物質,不會對電子集成回路產生影響,對服務器內部硬件不會有損壞,做一個形象的類比,你的手機掉入水中,十有八九會出問題,而掉入油中的話,則不會出現問題。

礦物油冷卻服務器

英特爾與Green Revolution Cooling的合作實驗中,對比了兩種機架服務器,其一是采用標準的數據中心的空氣冷卻技術,另外一個則是采用礦物油冷卻技術。

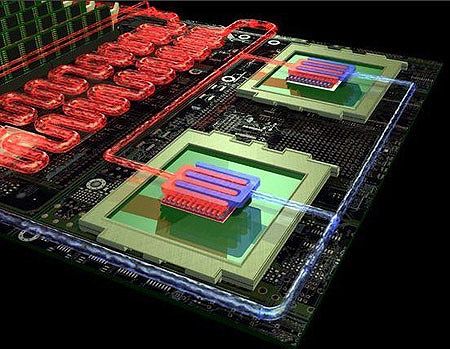

五,谷歌水冷服務器專利

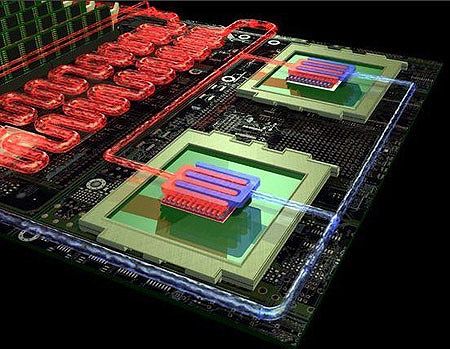

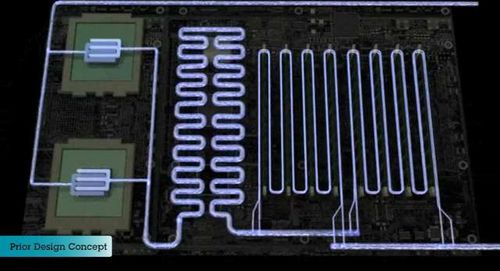

谷歌水冷服務器專利

谷歌早在2006年之前就開始研究水冷技術,并于2009年得到其水冷服務器的專利。谷歌水冷服務器專利的主要技術特點是服務器主板兩兩成對安裝在散熱片的兩個外側,由散熱片內流過溫度較低的冷凍水來帶走熱量。

其中高發熱的元件,比如CPU和南北橋芯片組等靠近散熱片內的冷凍水來安裝,從而發出的熱量被散熱片內的冷凍水就近帶走;而一些發熱量不高的器件,比如內存和硬盤等則直接安裝在稍遠離三明治散熱片中心的位置,部分案例中還有服務器風扇或電源風扇安裝在某側的服務器主板上,用于將內存和硬盤等的熱量帶走。

谷歌水冷服務器專利

谷歌早在2006年之前就開始研究水冷技術,并于2009年得到其水冷服務器的專利。谷歌水冷服務器專利的主要技術特點是服務器主板兩兩成對安裝在散熱片的兩個外側,由散熱片內流過溫度較低的冷凍水來帶走熱量。

其中高發熱的元件,比如CPU和南北橋芯片組等靠近散熱片內的冷凍水來安裝,從而發出的熱量被散熱片內的冷凍水就近帶走;而一些發熱量不高的器件,比如內存和硬盤等則直接安裝在稍遠離三明治散熱片中心的位置,部分案例中還有服務器風扇或電源風扇安裝在某側的服務器主板上,用于將內存和硬盤等的熱量帶走。

Google的數據中心把整個建筑視為風道的一部分,并沒有完全棄用水冷系統,而是將其升級進化,從而提高水冷系統的效率。

冷卻管道

通過Google在芬蘭Hamina數據中心照片,我們看到在熱風道上多組熱交換器。并且通過谷歌數據中心的冷卻管道我們知道,這里只靠海水來冷卻服務器。

存儲槽

谷歌數據中心重新利用了一個老造紙廠在造紙過程中使用的存儲槽。

在谷歌MayesCounty數據中心這樣照片里,我們看到數以百計的風扇直接將熱空氣排入密閉的風道,從冷卻塔來的冷水通過包裹金屬外層的水管輸送到風道頂端的熱交換器,熱空氣迅速被冷卻避免在風扇周圍聚集。

在谷歌MayesCounty數據中心這樣照片里,我們看到數以百計的風扇直接將熱空氣排入密閉的風道,從冷卻塔來的冷水通過包裹金屬外層的水管輸送到風道頂端的熱交換器,熱空氣迅速被冷卻避免在風扇周圍聚集。

MayesCounty數據中心巨大的風道

數據中心內部保持80華氏度(約等于26.67攝氏度),略高于其它數據中心。80華氏度的空氣進入服務器內部,然后被加熱。服務器后部的風扇將被加熱到接近120華氏度的空氣排入封閉的風道,熱空氣上升,并被頂部的熱交換器冷卻,被冷卻的空氣會從下方的活動地板排出。

但是這樣做的危險是一旦水冷管泄露,后果非常嚴重。

但是這樣做的危險是一旦水冷管泄露,后果非常嚴重。

六,“不一樣”的水冷系統

惠普位于俄克拉荷馬州塔爾薩(Tulsa)的數據中心采用了屋頂反射系統,避免陽光照射抬高數據中心室內溫度,它還有一個創新的水冷系統,這兩項創新設計節省了數百萬美元的成本,這個數據中心還可以抵御五級龍卷風的襲擊。塔爾薩數據中心有一個容量為8000000加侖的冷凍水儲存罐,在沒有開啟制冷裝置時,也可以支撐整個數據中心8小時的制冷。

惠普位于俄克拉荷馬州塔爾薩(Tulsa)的數據中心采用了屋頂反射系統,避免陽光照射抬高數據中心室內溫度,它還有一個創新的水冷系統,這兩項創新設計節省了數百萬美元的成本,這個數據中心還可以抵御五級龍卷風的襲擊。塔爾薩數據中心有一個容量為8000000加侖的冷凍水儲存罐,在沒有開啟制冷裝置時,也可以支撐整個數據中心8小時的制冷。

惠普塔爾薩數據中心全景圖

有數據統計,空調制冷的數據中心中。25%的能耗不是由計算設備產生而是由冷卻系統產生。因此,能好和碳排放方面,冷卻系統促成的壓力也越來越大。IBM也同樣認識到這一點,并很早著手進行水冷技術的研發和應用。在過去幾年,數千家企業受益于IBM的Rear Door Heat Exchanger背板換熱器技術,通過在服務器機架背板散熱,可以減少55%的空調制冷需求。

水冷服務器其實也不是個全新的概念,比如圖1是IBM聯合瑞士蘇黎世聯邦理工學院共同研發了一種名叫Aquasar的水冷超級計算機,它可以降低40%以上的能源消耗,減少85%的碳排放,同時將收集來的熱能用于建筑上的需求例如地熱。

從這個案例我們可以看到采用水冷服務器的主要好處是就近帶走熱量,可以有很高的節能效果,同時大大提高功率密度來縮小服務器的尺寸,減少風扇噪音,以及容易實現熱能回收等等好處。

超級計算機“SuperMUC”也采用水冷技術

德國加爾興萊布尼茨超級計算中心(LRZ)與IBM簽署合同,由后者負責開發、制造一套新的通用目的超級計算機“SuperMUC”也是水冷應用的典范。

主板水冷技術設計圖

相比于其他超級計算機,SuperMUC的特別之處還在于其水冷技術,傳統的超級計算機采用都是空氣制冷。根據之前IBM說法,通過水冷技術,SuperMUC能夠節能40%以上。

IBM水冷技術

SuperMUC采用的水冷技術是和IBM x iDataPlex一樣的技術,確切的說其實是溫水制冷技術,因為采用的40攝氏度的入水,而一般情況下,數據中心水冷都是采用16攝氏度的入水。

之所以采用溫水,原因在于水的二次利用,常見的數據中心水冷技術中,16度的水經過數據中心的服務器后,排出的水的溫度在20度左右,這些水由于溫度太低而不能在做其它用途,而IBM采用的溫水制冷技術,經過系統后排出的水能夠達到70多度。這些水能夠二次利用,例如為建筑物供暖等。

綠色高效對數據中心的重要性不言而喻,追求PUE值也成為了各大廠商宣傳自己數據中心的噱頭之一。然而對于數據中心來說,讓PUE值達到1.10是一個不小的挑戰,現在世界上PUE值達到這個目標的數據中心中基本上都是采用了不同的冷卻技術。

其實液冷技術的好處雖然不言而喻,但是滲漏還是大家所關注的問題。廠商要想讓大家接受液冷技術,那么他就要讓該設置既快捷又簡單。那么未來的話題就不會僅僅在電力能耗的問題上糾結了。

注:本文轉載自PConline,有刪改。

之所以采用溫水,原因在于水的二次利用,常見的數據中心水冷技術中,16度的水經過數據中心的服務器后,排出的水的溫度在20度左右,這些水由于溫度太低而不能在做其它用途,而IBM采用的溫水制冷技術,經過系統后排出的水能夠達到70多度。這些水能夠二次利用,例如為建筑物供暖等。

綠色高效對數據中心的重要性不言而喻,追求PUE值也成為了各大廠商宣傳自己數據中心的噱頭之一。然而對于數據中心來說,讓PUE值達到1.10是一個不小的挑戰,現在世界上PUE值達到這個目標的數據中心中基本上都是采用了不同的冷卻技術。

其實液冷技術的好處雖然不言而喻,但是滲漏還是大家所關注的問題。廠商要想讓大家接受液冷技術,那么他就要讓該設置既快捷又簡單。那么未來的話題就不會僅僅在電力能耗的問題上糾結了。

注:本文轉載自PConline,有刪改。

標簽: 點擊: 評論:

版權聲明:除非特別標注,否則均為本站原創文章,轉載時請以鏈接形式注明文章出處。